현실의 메타버스는 ‘AI와 감각’이다 -촉각, 후각감지 | 매거진에 참여하세요

현실의 메타버스는 ‘AI와 감각’이다 -촉각, 후각감지

#메타버스 #후각 #촉각 #감지 #초음파 #음성톤 #감정감지 #디지털향기 #냄새 #VR

"메타버스는 끝났다?" …진짜는 이제부터다

2021년의 메타버스 열풍은 그래픽 기반의 가상세계였다.

3D 아바타, 가상 공간, NFT 아이템… 그러나 문제는 현실감이 없었다.

“내가 정말 그 안에 있는 느낌”이 들지 않았기 때문이다.

하지만 2025년, 메타버스는 완전히 새로운 모습으로 돌아오고 있다.

그 핵심은 시각이 아닌 감각이다.

AI + 촉각 + 후각 + 센서 기반 감지 기술이 결합되면서 ‘오감으로 경험하는 가상현실’이 현실화되고 있다.

이제 메타버스는 더 이상 게임 속 이야기가 아니다.

실시간 AI가 감각을 분석하고 재현하는 물리적 인터페이스로 진화하고 있다.

AI가 ‘느낄 수 있는 몸’을 가질 때

사람은 감각으로 세상을 인식한다.

시각, 청각, 촉각, 후각, 미각, 이 중 가장 메타버스에 어려웠던 건 촉각과 후각이었다.

그런데 최근 몇 년 사이, AI가 실제 센서 데이터를 받아들이고 그에 따라 반응하거나 ‘가짜 감각’을 생성하는 기술이 폭발적으로 발전했다.

예: Ultraleap의 ‘공중 촉감 피드백’

초음파를 이용해 공중에서 손끝에 진동을 전달

버튼이 없는 화면에서도 누른 듯한 감각 생성

AI는 손의 위치·속도에 따라 진동 강도를 조절함

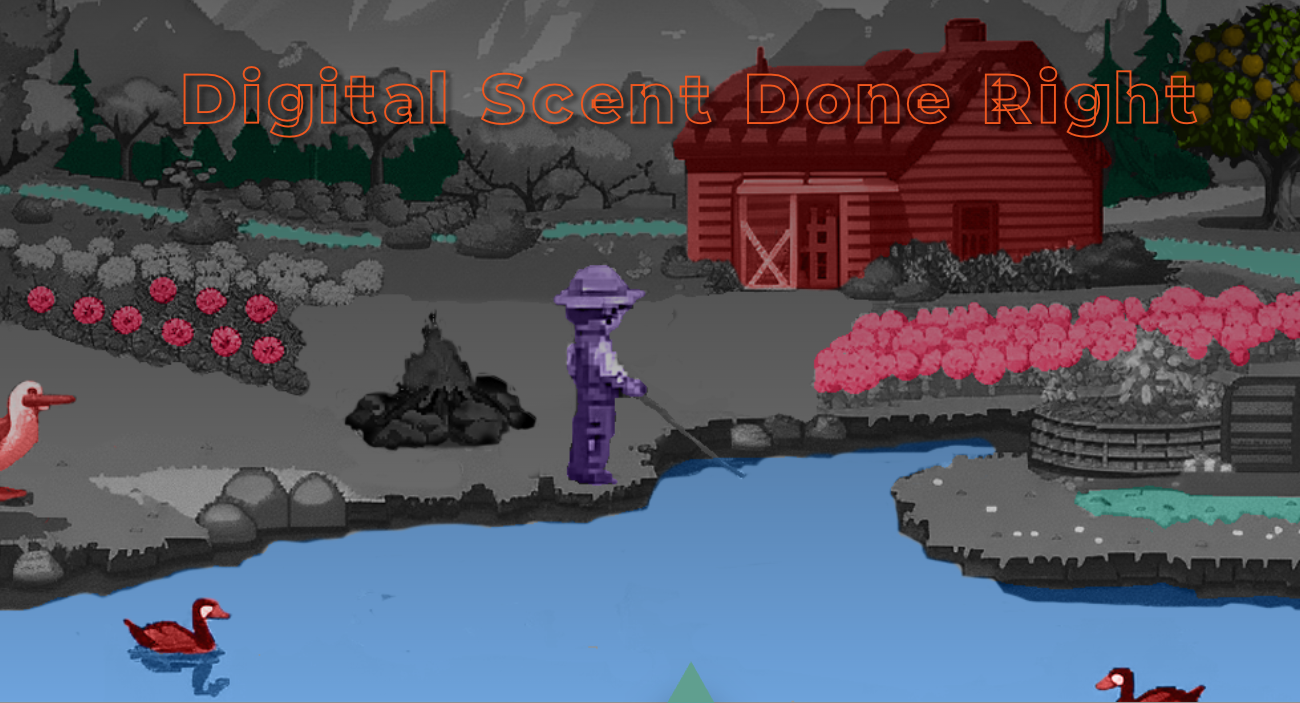

예: OVR Technology의 디지털 향기

디지털 향기 카트리지를 활용해 냄새를 시뮬레이션

AI가 영상·상황에 따라 향을 조합해 사용자에게 전달

VR 데이트 앱, 요리 게임, 명상 콘텐츠에서 실험 중

감각을 분석하는 AI, 감정을 파악하는 메타버스

메타버스가 단순히 ‘보는 공간’에서 ‘느끼는 공간’으로 확장되자 AI의 역할도 커졌다.

특히 사람의 감정 상태를 실시간으로 분석하고 반응하는 기능은 핵심이 되었다.

실시간 감정 감지 기술

- 심박수·땀·시선 추적으로 몰입도 측정

AI가 반응하는 메타버스 시나리오

당신이 지루해하면, AI 가이드가 대화를 전환 공포 게임 중 긴장하면, 진동/시각 효과를 강화 명상 앱에서는 호흡에 따라 배경이 잔잔하게 변화

AI는 단순한 정보 제공자가 아니라 당신의 감각과 감정에 ‘동기화’된 존재가 되어가고 있다.

Apple Vision Pro가 연 기술의 문

Apple이 Vision Pro를 통해 열어젖힌 건 단순한 MR(Mixed Reality) 헤드셋이 아니었다.

그들은 감각을 디지털화하는 방향성을 제시했다.

- 눈동자 추적 → 시선 기반 인터페이스

- 손가락 인식 → 물리적 컨트롤러 없는 제어

- 공간 오디오 → 방향성과 거리감까지 재현

여기에 GPT-4o 같은 멀티모달 AI가 결합되면? 당신의 표정, 움직임, 눈빛에 따라 메타버스가 반응하는 경험이 가능해진다.

예: ‘AI 감각 조정기’로 변한 메타버스

사용자가 피곤하면, 화면 밝기와 소리를 낮춤

감정 분석 후, AI가 콘텐츠를 추천하거나 템포 조절

실시간으로 몰입도를 측정하고 UI를 자동 조정

현실과 가상, 그 중간을 설계하는 기술자들

이제 메타버스를 만드는 사람은 단순히 3D 디자이너가 아니다.

촉각 디자이너, 후각 컨텐츠 개발자, 감정 인터페이스 설계자라는 완전히 새로운 직업군이 생기고 있다.

공중 촉감 UI를 위한 손 제스처 모델링 / 감정 흐름에 따른 대화 프레이밍 AI / 향기 UX 디자인을 위한 분자 구조 매핑

“느낄 수 없는 가상현실은 죽은 현실이다.”

지금 메타버스는 감각을 입고 부활하고 있다.

결론: 메타버스는 감각 기반의 경험 플랫폼이 된다

메타버스는 더 이상 메타버스라는 이름으로 팔리지 않는다. 하지만 그 본질은 살아 있다.

AI + 감각 기술이 만나서

진짜로 몰입할 수 있는 현실의 확장 공간이 되고 있는 것이다.

AI는 인간의 감정을 이해하고 감각 인터페이스는 인간의 몸과 이어지며 이 모든 기술은 우리가 새로운 현실을 ‘살게’ 한다

앞으로의 메타버스는 ‘게임’이 아니라 ‘삶’의 공간이 될 것이다. 그리고 그 중심에는, AI와 감각이 연결된 인터페이스가 있다.